Εικονογράφηση: Karl Peter Schwarz

Ο Τζέφρι Χίντον, που συχνά αποκαλείται «νονός της Τεχνητής Νοημοσύνης», είναι ένας πρωτοπόρος επιστήμονας υπολογιστών του οποίου το έργο στα νευρωνικά δίκτυα έθεσε τα θεμέλια για τη σύγχρονη τεχνητή νοημοσύνη. © Getty Images

Karl‑Peter Schwarz

Karl‑Peter Schwarz

Αυτό που ξεκίνησε ως επιστημονική ανακάλυψη έχει πλέον μετατραπεί σε πολύπλοκη απειλή ασφάλειας.

Εν συντομία

- Η γενετική τεχνητή νοημοσύνη επιταχύνεται παρά τα ηθικά και «ασφάλειας» ζητήματα.

- Η παραπληροφόρηση εξαπλώνεται ταχύτερα καθώς τα συστήματα χάνουν ακρίβεια και συγκράτηση.

- Οι στρατιωτικές και επιτηρητικές χρήσεις θολώνουν τα όρια μεταξύ άμυνας και ελέγχου.

Κύρια σημεία

- Ο Geoffrey Hinton, που συχνά αποκαλείται «νονός της AI», αποχώρησε από την Google τον Μάιο του 2023 και προειδοποίησε για τον κίνδυνο των «chatbots‑AI», βασισμένων στην έρευνά του για νευρωνικά δίκτυα.

- Ο ίδιος υποστήριξε ότι οι άνθρωποι ήδη «πνίγονται» από ψεύτικες φωτογραφίες, βίντεο και κείμενα στο διαδίκτυο και διατρέχουν τον κίνδυνο να χάσουν την ικανότητα διάκρισης μεταξύ πραγματικού και φανταστικού.

- Εκατοντάδες χιλιάδες ερευνητές, επιχειρηματίες και διευθυντικά στελέχη (όπως Elon Musk, Steve Wozniak) έχουν υπογράψει ανοικτή επιστολή που ζητά αναστολή για τουλάχιστον έξι μήνες της εκπαίδευσης υπερ‑αποτελεσματικών συστημάτων AI, μέχρι να διασφαλιστούν οι θετικές επιπτώσεις και η διαχειρισιμότητα των κινδύνων. (GIS Reports)

- Παρά τις προειδοποιήσεις, οι μεγάλες τεχνολογικές εταιρείες δεν έχουν επιβραδύνει την επιδίωξή τους για υπερτεχνητή νοημοσύνη — ο ανταγωνισμός τους ωθεί να επιταχύνουν.

- Η απουσία δεσμευτικού διεθνούς νομικού πλαισίου σημαίνει ότι δεν υπάρχουν ουσιαστικοί περιορισμοί στην έρευνα σε αυτό το πεδίο.

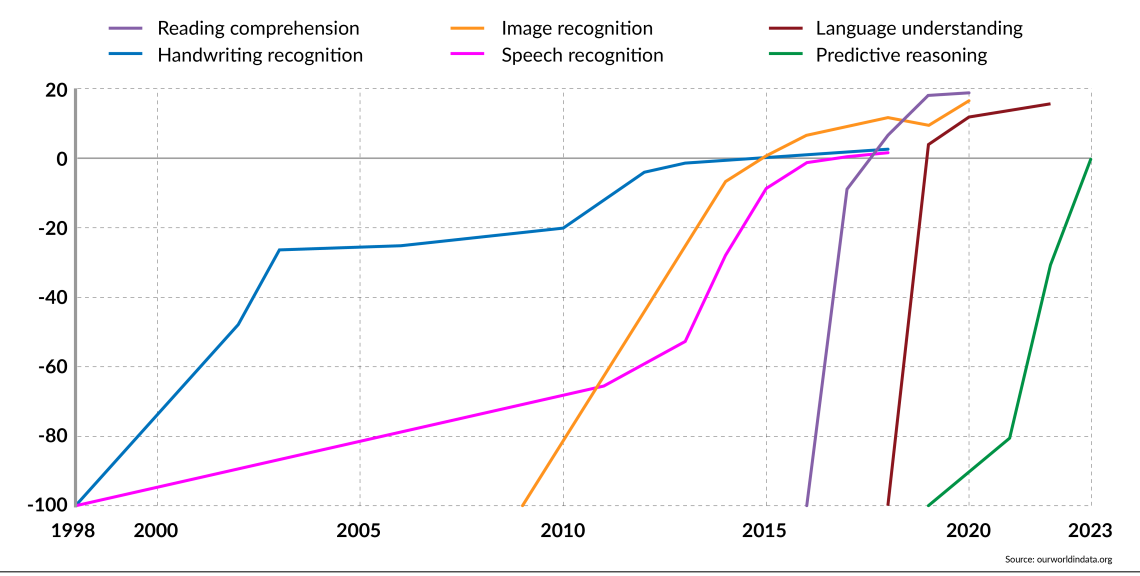

- Η AI έχει συγκριθεί σε μετασχηματιστική δύναμη με τη μετάβαση από τη ζωή των κυνηγών‑τροφοσυλλεκτών σε αυτή των γεωργών ή με την εφεύρεση της τυπογραφίας — είναι ξεκάθαρο πως θα μεταμορφώσει τον κόσμο, αλλά οι εκτιμήσεις για το μέλλον της είναι πολύ λιγότερο αξιόπιστες.

- Έρευνα δείχνει ότι τα συστήματα γενετικής AI δεν μπορούν αξιόπιστα να εντοπίζουν και να διορθώνουν παραπληροφόρηση στα κοινωνικά μέσα — στην πραγματικότητα, η πιθανότητα αυτά τα εργαλεία να διαδίδουν ψευδείς πληροφορίες για τρέχοντα γεγονότα έχει σχεδόν διπλασιαστεί σε έναν χρόνο: σε μία μελέτη, το 35 % των απαντήσεων που παραχθήκαν από AI περιείχαν ψευδείς ισχυρισμούς, ενώ το ποσοστό μη απαντηθέντων ερωτημάτων έπεσε από 31 % τον Αύγουστο του 2024 στο μηδέν — δηλαδή η AI εξακολουθεί να παρέχει απάντηση ακόμη και όταν τα δεδομένα δεν τη δικαιολογούν.

Αντί να αναγνωρίζουν τα δικά τους όρια, τα εν λόγω συστήματα γίνονται όλο και περισσότερο δίαυλοι για ψευδείς πληροφορίες. Πράκτορες παραπληροφόρησης πλημμυρίζουν το διαδίκτυο με κατασκευασμένο υλικό μέσω ασαφών ιστοσελίδων, αναρτήσεων στα κοινωνικά μέσα και «φάρμων» περιεχομένου παραγόμενου από AI, τα οποία τα chatbots δεν διακρίνουν από έγκυρα μέσα. Οι προσπάθειες να γίνουν αυτά τα συστήματα πιο ενημερωμένα και πληροφορητικά έχουν, ειρωνικά, κάνει τα ίδια πολύ πιο ευάλωτα σε χειραγώγηση και προπαγάνδα.

Η AI επιτρέπει σε πράκτορες παραπληροφόρησης να επιτυγχάνουν πολύ μεγαλύτερη εμβέλεια και επίδραση με ελάχιστο κόστος και προσπάθεια σε σύγκριση με τα παραδοσιακά εργαλεία προπαγάνδας όπως ραδιόφωνο, τηλεόραση ή έντυπο τύπο. Καθώς η γραμμή μεταξύ αλήθειας και ψεύδους θολώνει, η δημόσια εμπιστοσύνη στους δημοκρατικούς θεσμούς φθίνει, δημιουργώντας περισσότερο χώρο για να εδραιωθούν ακροακρατικές αφηγήσεις. Με αυτή την έννοια, η AI έχει γίνει ένα σημαντικό εργαλείο τόσο για αυταρχικές κυβερνήσεις όσο και για μη κρατικές ομάδες που επιδιώκουν να υπονομεύσουν τη δημοκρατική ανθεκτικότητα και να προωθήσουν τις δικές τους ατζέντες.

Εκμετάλλευση της AI για πολιτικούς σκοπούς

Όσο πιο συχνά κυκλοφορούν ψευδείς πληροφορίες, τόσο πιο οικείες και πιστευτές γίνονται. O όρος «παραπληροφόρηση» (disinformation) — που πρωτοχρησιμοποιήθηκε στην εποχή του Στάλιν — προέρχεται από το πλαίσιο του ασύμμετρου πολέμου: η Σοβιετική Ένωση επιδίωξε να αντισταθμίσει το οικονομικό και στρατιωτικό μειονέκτημά της έναντι των ΗΠΑ μέσω της δύναμής της στις μυστικές επιχειρήσεις και στη διαχείριση της κοινής γνώμης στη Δύση. Η Ρωσία αργότερα βελτίωσε αυτές τις μεθόδους, αναπτύσσοντας εκτεταμένες καμπάνιες παραπληροφόρησης κατά τον πόλεμο του 2008 στη Γεωργία και, ακόμη περισσότερο, στον πόλεμο στην Ουκρανία.

Το 2013, ο (πλέον εκλιπών) ιδρυτής της στρατιωτικής ομάδας Wagner, Yevgeny Prigozhin, δημιούργησε την “Internet Research Agency” στην Αγία Πετρούπολη, η οποία άρχισε να πλημμυρίζει τα κοινωνικά δίκτυα με bots, trolls, ψεύτικες ιστοσελίδες και υποτιθέμενους εμπειρογνώμονες για να διαδώσουν τις ρωσικές αφηγήσεις περί απειλής για τη Ρωσία από το ΝΑΤΟ και την Ουκρανία.

Σύμφωνα με έκθεση προς το Κογκρέσο των ΗΠΑ τον Ιανουάριο, η ρωσική κυβέρνηση ενδιαφέρεται για «την υπονόμευση της εμπιστοσύνης στους δημοκρατικούς θεσμούς των ΗΠΑ, τον πολλαπλασιασμό των κοινωνικο‑πολιτικών διαιρέσεων στις ΗΠΑ, και την εξασθένιση της δυτικής στήριξης προς την Ουκρανία». Όλες οι ρωσικές υπηρεσίες εξωτερικής πληροφοριών διαθέτουν κυρίως κυβερνοκλάδους που διενεργούν ποικιλία επιχειρήσεων κατασκοπείας, σαμποτάζ και παραπληροφόρησης. Αυτός ο «σκιά» πόλεμος αποτελεί μέρος του ρωσικού υβριδικού πολέμου, που στοχεύει στη Δύση μέσω συμβατικών και μη συμβατικών τακτικών χωρίς τον κίνδυνο πλήρους πολέμου.

Η AI επιτρέπει ορισμένες επιχειρήσεις επιρροής να διενεργούνται από έναν απλό υπολογιστή γραφείου, μειώνοντας την ανάγκη για φυσική παρουσία. Γερμανικές πληροφορίες υποστηρίζουν ότι η Μόσχα έχει χρησιμοποιήσει κανάλια όπως το Telegram για να στρατολογήσει νέους φιλορωσικούς στη Γερμανία για εμπρησμούς και σαμποτάζ, και τόσο οι ρωσικές όσο και οι κινεζικές υπηρεσίες έχουν διεισδύσει σε ψηφιακά συστήματα κρίσιμων υποδομών σε βαθμό που θα μπορούσαν πιθανώς να διαταράξουν δίκτυα ενέργειας ή σιδηροδρόμων. Σε αντίθεση με τις δυτικές υπηρεσίες, οι παράγοντες που υποστηρίζονται από αυταρχικά καθεστώτα συχνά λειτουργούν με λιγότερους νομικούς ή κοινοβουλευτικούς περιορισμούς, κάτι που καθιστά τις δραστηριότητές τους δυσκολότερες στην παρακολούθηση και ρύθμιση.

Στον παγκόσμιο αγώνα για AI, οι ΗΠΑ και η Κίνα προηγούνται πολύ έναντι των άλλων ανταγωνιστών, όμως και οι δύο αντιμετωπίζουν αυξανόμενες οικονομικές και ασφαλείας πιέσεις. Η Κίνα έχει επενδύσει τεράστιους πόρους σε έρευνα, ανάπτυξη και υποδομές για την επέκταση των βιομηχανιών της που βασίζονται στην AI. Οι ΗΠΑ, με τη σειρά τους, έχουν εισαγάγει εμπορικούς περιορισμούς, ελέγχους εξαγωγών και δασμούς για να προστατεύσουν το τεχνολογικό τους πλεονέκτημα και να περιορίσουν την πρόσβαση της Κίνας σε κρίσιμα συστατικά της AI. Πολλές κινεζικές εταιρείες έχουν μπλοκαριστεί σε αμερικανικές «μαύρες λίστες» με επίκληση εθνικής ασφάλειας.

Η AI και ο υβριδικός πόλεμος

Ο ιδρυτής της Palantir Technologies, Alexander Karp, έχει επικρίνει τη Silicon Valley για εστίαση στο καταναλωτικό λογισμικό αντί σε εργαλεία για αξιόπιστη αποτροπή, και επιρρίπτει ευθύνες στην Ουάσινγκτον για αποτυχία κατανόησης των συνεπειών ταχείας τεχνολογικής αλλαγής. Το 2024, το U.S. Department of Defense διέθεσε 1,8 δισεκατομμύρια δολάρια για έρευνα και ανάπτυξη AI — μόλις 0,2 % του προϋπολογισμού των 886 δισεκατομμυρίων δολαρίων.

Έχει πλέον γίνει σαφές ότι το NATO, παρά τον εξοπλισμό του με όπλα τελευταίας τεχνολογίας, δεν βρίσκεται σε θέση να αποκρούσει επαρκώς επίθεση με drones. Το βράδυ της 10 Σεπτεμβρίου, σμήνος 19 ρωσικών καμικάζι drones πέρασε πάνω από την επικράτεια του κράτους‑μέλους της NATO Πολωνίας για πρώτη φορά. Πολωνικά και ολλανδικά μαχητικά, με τη βοήθεια ιταλικού αεροσκάφους αναγνώρισης και δύο γερμανικών πυραυλικών συστημάτων Patriot, κατέφεραν να καταρρίψουν μόλις τέσσερα από αυτά — μια τεράστια, δαπανηρή προσπάθεια να αντιμετωπισθεί απειλή την οποία οι Ουκρανοί αντιμετωπίζουν καθημερινά από την έναρξη της ρωσικής εισβολής τον Φεβρουάριο του 2022.

Στη διάρκεια μιας μόνης νύχτας, στις 7 Ιουλίου (ή στις 7 Σεπτεμβρίου ‑ διαφοροποιήσεις αναφέρονται), η Ρωσία ανέπτυξε πάνω από 800 μαχητικά drones και 13 πυραύλους, από τους οποίους οι ουκρανικές Ένοπλες Δυνάμεις κατέφεραν να αναχαιτίσουν 747 drones και τέσσερις κρουαζιερόπυραυλους. Ήταν η μεγαλύτερη επίθεση με drones στην ιστορία μέχρι σήμερα. Στον πόλεμο Ρωσίας‑Ουκρανίας, μεταξύ 70% και 80% των καθημερινών απωλειών μάχης και στις δύο πλευρές οφείλονται σε drones. Το NATO «κοιμάται» στην αρχή της νέας εποχής πολέμου.

Τον Μάρτιο του 2020, χρησιμοποιήθηκε για πρώτη φορά ανθρωποκτόνος ρομπότ σε εμφύλιο πόλεμο στη Λιβύη — ένα αυτόνομο drone που μπορεί αυτόνομα να πλοηγηθεί και να εξουδετερώσει στόχους. Ήταν το τουρκικής κατασκευής Kargu‑2, το οποίο μπορεί να λειτουργεί είτε χειροκίνητα είτε αυτόματα. Αφρικανικές χώρες χρησιμοποιούν τώρα τέτοια drones εναντίον ανταρτών. Η Τουρκία, η Ινδία καθώς και άλλες χώρες της Παγκόσμιας Πλειοψηφίας αντιτίθενται στον περιορισμό ή ρύθμιση των θανατηφόρων αυτόνομων οπλικών συστημάτων.

Για τον στοχευμένο φόνο τρομοκρατών, το Ισραήλ χρησιμοποιεί τη βάση δεδομένων «Lavender», η οποία αναγνώρισε δεκάδες χιλιάδες μέλη της Χαμάς και άλλων παλαιστινιακών οργανώσεων μεταξύ των περίπου 2,3 εκατομμυρίων κατοίκων της Ζώνης της Γάζας, με τη βοήθεια συστημάτων στόχευσης μέσω τεχνητής νοημοσύνης. Τέτοια συστήματα εκπαιδεύονται βάσει δεδομένων που περιλαμβάνουν φύλο, ηλικία, εμφάνιση, πρότυπα κινήσεων και δραστηριότητες σε κοινωνικά δίκτυα, μεταξύ άλλων.

Ενώ η Ευρωπαϊκή Ένωση διεξάγει σφοδρές συζητήσεις για την κυριαρχία των δεδομένων και τον ατομικό έλεγχο των προσωπικών πληροφοριών, η πραγματικότητα είναι ότι τα δεδομένα των ανθρώπων ήδη συλλέγονται ευρέως, αναλύονται και διαπραγματεύονται. Πέρα από το γεγονός ότι κάθε εφαρμογή αφήνει ψηφιακά ίχνη και πολλοί χρήστες μοιράζονται εθελοντικά ευαίσθητες πληροφορίες, τα δεδομένα από αισθητήρες smartphone όπως επιταχυνσιόμετρο (accelerometer), γυροσκόπιο (gyroscope) και μαγνητόμετρο (magnetometer) μπορούν να αναλυθούν για να ταυτοποιήσουν άτομα με υψηλή ακρίβεια.

Σενάρια

Πιθανό: Διεύρυνση της τεχνολογικής σχάσης

Δεν υπάρχει τρόπος να σταματήσει η εξέλιξη της τεχνητής νοημοσύνης. Χώρες όπως οι ΗΠΑ και η Κίνα, που διαθέτουν τη γνώση και επαρκή υπολογιστική ισχύ, θα διευρύνουν το οικονομικό και στρατιωτικό τους πλεονέκτημα έναντι μικρότερων κρατών, ιδίως αυτών της Παγκόσμιας Πλειοψηφίας. Αυτό θα αυξήσει την παγκόσμια ανισότητα και θα προξενήσει νέες συγκρούσεις.

Απίθανο: Παγκόσμια απαγόρευση των αυτόνομων οπλικών συστημάτων

Υπό τις τρέχουσες συνθήκες, είναι απίθανο η έρευνα και παραγωγή αυτόνομων οπλικών συστημάτων να μπορέσουν να σταματήσουν μέσω διεθνών συμφωνιών. Αυτό θα μπορούσε ίσως να αλλάξει, αν η διεθνής κοινότητα συνειδητοποιήσει τον κίνδυνο — για παράδειγμα, στην περίπτωση που θανατηφόρα αυτόνομα οπλικά συστήματα προγραμματισμένα με γενετικά κριτήρια χρησιμοποιηθούν για εθνοκάθαρση σε πόλεμο.

Πιθανό: Διάβρωση της ιδιωτικότητας και των δημοκρατικών ελευθεριών

Για λόγους εξωτερικής και εσωτερικής ασφάλειας, κανένα κράτος — έστω και δημοκρατικό — δεν θα μπορέσει να παραμερίσει μόνιμα τις δυνατότητες επιτήρησης που προσφέρουν τα συστήματα τεχνητής νοημοσύνης. Οι πολίτες αναμένεται να αποδεχτούν σημαντικούς περιορισμούς στην ελευθερία τους στο πλαίσιο ενός τεχνο‑αυταρχισμού.