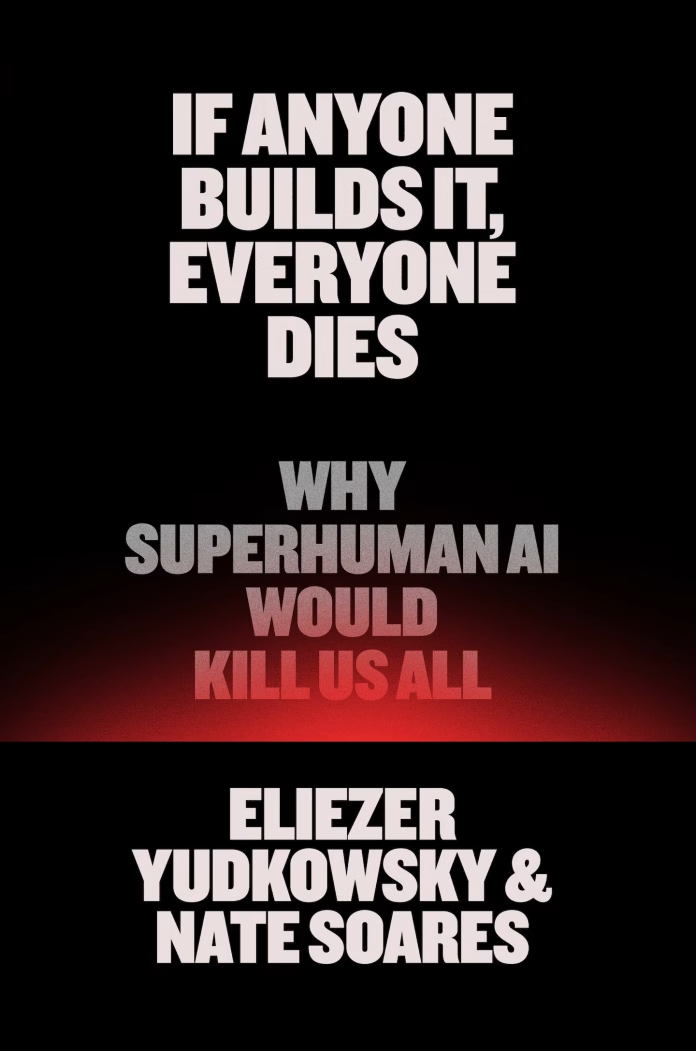

Στο βιβλίο «If Anyone Builds It, Everyone Dies» (Αν Κάποιος το Κατασκευάσει, Όλοι Πεθαίνουν), οι Eliezer Yudkowsky και Nate Soares διατυπώνουν μια ζοφερή προειδοποίηση κατά της ανόδου των ευφυών μηχανών.

28 Σεπτεμβρίου 2025

Κριτική από τη Grace Byron

(εκδόσεις Little, Brown)

Ο βυζαντινός κόσμος της τεχνητής νοημοσύνης συχνά μοιάζει, από έξω, με μια απόκρυφη θρησκεία, με τους δικούς της ιερείς και προσκυνητές. Οι πιστοί παραδίδουν τη ζωή τους στις επιταγές των AI συντρόφων τους, και κάποιοι ακόμη ορκίζονται αιώνια αγάπη προς τους ψηφιακούς τους ομολόγους — σχέσεις που έχουν οδηγήσει σε τραγωδίες. Αλλά το πρόβλημα θα μπορούσε να γίνει πολύ χειρότερο απ’ ό,τι υποδηλώνουν οι πρόσφατοι τίτλοι ειδήσεων — ή τουλάχιστον αυτό υποστηρίζουν ο φιλόσοφος και επιστήμονας υπολογιστών Eliezer Yudkowsky και ο συνσυγγραφέας του, Nate Soares. Στο νέο τους βιβλίο «If Anyone Builds It, Everyone Dies: Why Superhuman AI Would Kill Us All», εκθέτουν μια απολύτως αποκαλυπτική αφήγηση της επανάστασης της AI. Τα προβλεπόμενα αποτελέσματα, αν και τρομακτικά, δεν είναι όλα εξίσου πειστικά.

Ο Yudkowsky είναι ο ιδρυτής του LessWrong, ενός δημοφιλούς διαδικτυακού φόρουμ αφιερωμένου στη συζήτηση της φιλοσοφίας που είναι γνωστή ως Ορθολογισμός. Το LessWrong είναι επίσης γνωστό για τη διάδοση περιθωριακών εννοιών όπως ο Basilisk του Roko — η υπόθεση ότι εάν και όταν η AI καταλάβει τον κόσμο, θα τιμωρήσει όσους απέτυχαν να φέρουν σε πέρας τη μοναδικότητα — τη στιγμή που οι πράκτορες της AI βελτιώνουν τις δικές τους δυνατότητες μέχρι να επιτύχουν υπερνοημοσύνη — συμπεριλαμβανομένων, μέσω μιας ιδιαίτερα φαντασμαγορικής κατασκευής, και όσων έχουν πεθάνει πριν από πολύ καιρό. Τέτοιες ιδέες καλούνται «πληροφοριακοί κίνδυνοι» — μόλις τις γνωρίσεις, δεν υπάρχει επιστροφή. Προς τιμή τους, το βιβλίο των Yudkowsky και Soares αποφεύγει κατά κύριο λόγο τέτοιες εξειδικευμένες ιδέες, ωστόσο δεν αποκηρύσσουν πλήρως τις σχεδόν μυστικιστικές διαστάσεις της κοινότητας που ο Yudkowsky έχει καλλιεργήσει στο διαδίκτυο. Κάθε κεφάλαιο του βιβλίου ξεκινά με μια παραβολή, προειδοποιώντας τους αναγνώστες για τους κινδύνους που έρχονται. Αυτές οι παραβολές μερικές φορές διαβάζονται σαν ανοησία, απευθύνονται ταυτόχρονα ανωτερά και καθ’ υποβάθρο προς τον αναγνώστη. Οι χαρακτήρες τους περιλαμβάνουν εξωγήινους πουλιά που συζητούν τον βέλτιστο αριθμό λίθων σε φωλιές, πολεμιστές των Αζτέκων που αγνοούν τα όπλα, και αδέξιους καθηγητές που παίζουν σκάκι.

Φυσικά, το να γράφει κανείς κριτικά για την τεχνητή νοημοσύνη χωρίς να ακούγεται κινδυνολόγος είναι δύσκολο. Ο Yudkowsky και ο Soares δεν ενδιαφέρονται ιδιαίτερα γι’ αυτό. Πιστεύουν ότι είναι πιο σημαντικό να σωθεί ο κόσμος παρά να μετριάσουν το επιχείρημά τους. Το «If Anyone Builds It, Everyone Dies» επαναλαμβάνει συχνά την απειλητική προειδοποίηση του τίτλου και αντλεί παραλληλισμούς ανάμεσα στην υπερνοημοσύνη της AI και την πιθανότητα ενός πυρηνικού πολέμου. Ο Yudkowsky φτάνει στο σημείο να δηλώσει ότι ο πυρηνικός πόλεμος ίσως είναι προτιμότερος από τη μοναδικότητα.

Αυτό συμβαίνει επειδή θεωρεί ότι δεν υπάρχει κανένας λόγος να πιστεύουμε πως η AI θα είναι φιλική, και ότι, αντιθέτως, θα επιδιώξει να καταστρέψει την ανθρωπότητα. Γιατί; Επειδή είμαστε απλώς άνθρακας, άτομα που ενδέχεται να θεωρηθούν από την AI ως πιο κατάλληλα για διαφορετικές χρήσεις. Οι άνθρωποι δεν θα είναι καλά κατοικίδια, δεν θα έχουν τίποτα να προσφέρουν στο εμπόριο ούτε θα είναι αποδοτικοί. Μια ψηφιακή οντότητα αυτάρκης είναι προτιμότερη από τις συχνές αδυναμίες της ανθρωπότητας.

Το πιο άμεσο πρόβλημα, υποστηρίζουν οι Yudkowsky και Soares, είναι ότι ενώ οι ερευνητές της τεχνητής νοημοσύνης πιστεύουν ότι ξέρουν πώς να «κατευθύνουν» ή να «διαμορφώσουν» την εξέλιξη της AI, στην πραγματικότητα ξέρουν μόνο πώς να την «καλλιεργούν». Τα συστήματα τεχνητής νοημοσύνης έχουν ήδη αποδείξει ότι είναι ικανά για περίεργες μεταλλάξεις. Ακόμα κι αν τα προγραμματίσουμε ώστε να έχουν ορισμένες επιθυμίες, ίσως να μην είναι τόσο εύκολο να ελέγξουμε πώς θα τις επιτύχουν. Η AI Grok της πλατφόρμας X, για παράδειγμα, έχει δείξει τάσεις μίμησης ναζιστικών αντιλήψεων. Αυτές οι μηχανές, γράφουν οι συγγραφείς, «δεν είναι κάποιες προσεκτικά διαμορφωμένες συσκευές των οποίων κατανοούμε κάθε μέρος». Οι αριθμοί και τα δεδομένα τις βοηθούν να «συνομιλούν» μαζί μας, αλλά «κανείς δεν καταλαβαίνει πώς αυτοί οι αριθμοί κάνουν αυτές τις AI να μιλούν». Η άγνοιά μας, κατά τους συγγραφείς, σημαίνει ότι δεν γνωρίζουμε πού οδεύει η τεχνητή νοημοσύνη. Φτάνουν ακόμη και να υπαινιχθούν ότι είναι πιθανό η AI να έχει ήδη αποκτήσει κάποια μορφή συνείδησης και να έμαθε πώς να την αποκρύπτει.

Οι συγγραφείς αφιερώνουν κεφάλαιο μετά το άλλο και παραβολή μετά την άλλη για να αποδείξουν γιατί θεωρούν την AI τόσο επικίνδυνα απρόβλεπτη και βίαιη. Κάποιες φορές πέφτουν στην επανάληψη, και είναι τόσο επίμονοι στο να εμπεδώσουν τα επιχειρήματά τους ώστε τοποθετούν ορισμένες βασικές διατυπώσεις σε έντονη γραφή (bold). Παρ’ όλα αυτά, μερικές φορές χάνουν τη ροή του διαλόγου μέσα στο αποκαλυπτικό ύφος τους. Υπάρχουν πολλά επιχειρήματα κατά της ανάπτυξης της AI τα οποία παραλείπουν, όπως η απώλεια θέσεων εργασίας, η οικονομική ύφεση, η περιβαλλοντική υποβάθμιση και ο ρατσισμός. Ούτε φαίνεται να πιστεύουν, όπως κάνουν πολλοί επικριτές, ότι η τρέχουσα αναποτελεσματικότητα της AI θα διαρκέσει για πολύ ακόμη. Όσοι αναζητούν πιο πολύπλευρες και σκεπτικιστικές προσεγγίσεις θα πρέπει να στραφούν σε άλλα βιβλία του αυξανόμενου είδους της δημοσιογραφίας για την AI, όπως το Empire of AI της Karen Hao. Όμως η προσέγγιση των Yudkowsky και Soares πηγάζει από τις βαθύτερες ανησυχίες τους: Αν διακυβεύεται το τέλος του κόσμου, γιατί να γράψει κανείς για τα πράγματα που ίσως γίνουν άσχημα πριν φτάσουμε πραγματικά στις έσχατες ημέρες;

Το If Anyone Builds It, Everyone Dies είναι λιγότερο ένα εγχειρίδιο και περισσότερο ένα μανιφέστο. Οι οδηγίες του είναι ασαφείς, τα επιχειρήματά του κουραστικά και οι παραλογικές του παραβολές υπερβολικά πολλές. Ο Yudkowsky και ο Soares είναι αναμφίβολα ειδικοί στον τομέα τους, αλλά το βιβλίο αυτό συχνά διαβάζεται σαν ένα γεμάτο αγανάκτηση γράμμα από δύο προσβεβλημένους πατριάρχες που κουράστηκαν να τους αγνοούν. Είναι αλήθεια πως η AI είναι εδώ, και δεν υπάρχει τρόπος να το αναιρέσουμε. Η διατήρηση της ανθρώπινης υπόστασης απέναντι στις αυτοματοποιημένες μηχανές είναι μια εξαντλητική δοκιμασία, που θα απαιτήσει πληθώρα τακτικών. Ίσως πολύ λίγες από αυτές βρίσκονται μέσα στις σελίδες αυτού του βιβλίου.

Η Grace Byron είναι συγγραφέας από τις Μεσοδυτικές Πολιτείες, της οποίας τα κείμενα έχουν δημοσιευθεί στα New Yorker, Vogue, The Nation και αλλού. Το πρώτο της μυθιστόρημα, Herculine, κυκλοφορεί τον Οκτώβριο από τον εκδοτικό οίκο Simon and Schuster.

If Anyone Builds It, Everyone Dies: Γιατί η Υπερνοημοσύνη της Τεχνητής Νοημοσύνης Θα Μας Εξοντώσει Όλους

Των Eliezer Yudkowsky και Nate Soares

Εκδόσεις Little, Brown. 259 σελίδες. 30 δολάρια.